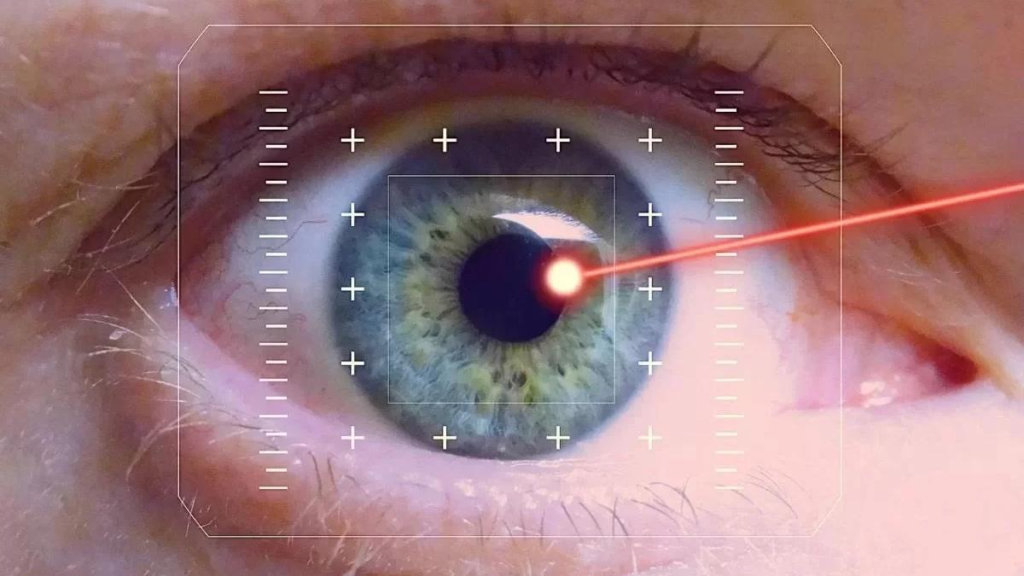

Recentemente, uma empresa vem gerando polêmica ao pagar para escanear a íris das pessoas em diferentes locais do mundo — inclusive o Brasil. Para quem não sabe, a íris é a parte “colorida” do olho, que possui diferentes ranhuras e padrões. Cada pessoa tem um desenho único na íris, como se fosse uma impressão digital ocular. Pois bem, em São Paulo, uma série de pessoas entrou na onda de receber dinheiro para escanear sua íris. E o processo para isso é digno de um episódio de Black Mirror.

Para começar, é preciso baixar um aplicativo e fazer um cadastro. Depois, ir ao local indicado no app para ter sua íris escaneada, e aguardar 24 horas para receber seu dinheiro. Passado o tempo de espera, a pessoa recebe, em média, 48 worldcoin, uma criptomoeda (como o famoso Bitcoin) que pode ser convertida em reais e, em seguida, sacada em qualquer banco. Não parece enredo de filme de ficção?

Quem é que quer escanear a íris das pessoas?

Por trás dessa polêmica iniciativa, está a Tools for Humanity, empresa cofundada por Sam Altman, CEO da OpenIA, a mesma por trás do ChatGPT. E a Tools, por sua vez, tem parceria com a Fundação World, uma entidade sem fins lucrativos desenvolvida pela Tools e sediada nas Ilhas Cayman (Territórios Ultramarinos Britânicos, no Caribe). Sim, aquele famoso paraíso fiscal.

De acordo com as organizações, a ideia por trás desse projeto é “ajudar as pessoas a diferenciar interações humanas reais daquelas impulsionadas por inteligência artificial”. Ou seja, criar uma forma de verificar a humanidade, isto é, se aquelas são pessoas reais ou robôs.

Conforme o portal Tilt, do UOL, afirma, mais de 22 milhões de pessoas já baixaram o app da empresa (WorldApp) no mundo, sendo um milhão apenas no Brasil. E dessas, dez milhões fizeram a verificação de íris — 400 mil em nosso país.

Qual a polêmica no escaneamento da íris?

“Ah, mas a gente dá nossas impressões digitais ao governo, qual o problema de ganhar dinheiro para escanear a íris?”.

Enquanto muitas pessoas se perguntam isso, quase ninguém sabe ao certo o que as organizações por trás desse projeto ganham em pagar pelos dados da íris das pessoas. Afinal, pela lógica acima, o governo não dá dinheiro em troca das impressões digitais e elas ficam em um banco de dados de segurança nacional. Por outro lado, ninguém sabe o que a Tools faz com as informações e as imagens de quem recebeu para escanear a íris.

Ainda segundo o UOL, a maioria das pessoas que aceitou participar do processo não sabia quase nada do projeto. Elas apenas precisavam muito de dinheiro, em média, 600 reais. Acontece que a impressão da íris, por ser única, é considerado um “dado sensível”, ou seja, extremamente importante. Então, ceder assim ao escaneamento sem saber para que as imagens e dados serão utilizados é considerado um risco pela ANPD (Autoridade Nacional de Proteção de Dados).

“Não sabemos ainda como essas informações serão utilizadas quando associadas em conjunto com algoritmos avançados, além da inteligência artificial (IA), podendo ser aberta uma porta para abusos, crimes e irregularidades”, alerta Karen Borges. Ela é gerente adjunta da Assessoria Jurídica do Núcleo de Informação e Coordenação do Ponto BR (NIC.br) à Agência Brasil. “Estamos falando de um dado biométrico único em termos de dado pessoal. É um dado que é capaz de te identificar e te autenticar desde o início da sua vida até o final dela. Então existe uma sensibilidade muito grande em ceder esse tipo de dado para uma iniciativa como essa”, completou.

Cheirinho de Black Mirror no ar com essa história toda, não é mesmo? Já pensou, você não ter o poder de dizer que o desenho da sua íris é seu mesmo porque uma empresa pegou e registrou como dela? Ou ter o desenho copiado e impresso na íris de um robô para que ele se passe por humano? Definitivamente tudo parece coisa de filme. Mas diante de tecnologias que pareciam impossíveis e hoje são reais, como o próprio ChatGPT, não tem como essa história não gerar polêmica…

Fotos: Reprodução